Google lance une application de dictée IA hors ligne avec Gemma : l'IA embarquée redéfinit la productivité vocale

Google frappe fort (et discrètement) dans la dictée IA

Dans un mouvement presque furtif, Google vient de lancer une application de dictée basée sur l'intelligence artificielle, conçue pour fonctionner en priorité hors ligne. Propulsée par les modèles Gemma — la famille de modèles IA légers et open-source de Google — cette application s'attaque directement à des concurrents établis comme Wispr Flow.

« Google's new offline-first dictation app uses Gemma AI models to take on the apps like Wispr Flow. »

Ce lancement n'est pas anodin. Il illustre une tendance de fond qui transforme profondément le paysage de l'IA : le passage d'une intelligence artificielle dépendante du cloud vers une IA embarquée sur l'appareil (on-device AI). Pour les professionnels, les entreprises et les développeurs, les implications sont considérables.

Qu'est-ce que l'IA embarquée (on-device AI) et pourquoi est-ce révolutionnaire ?

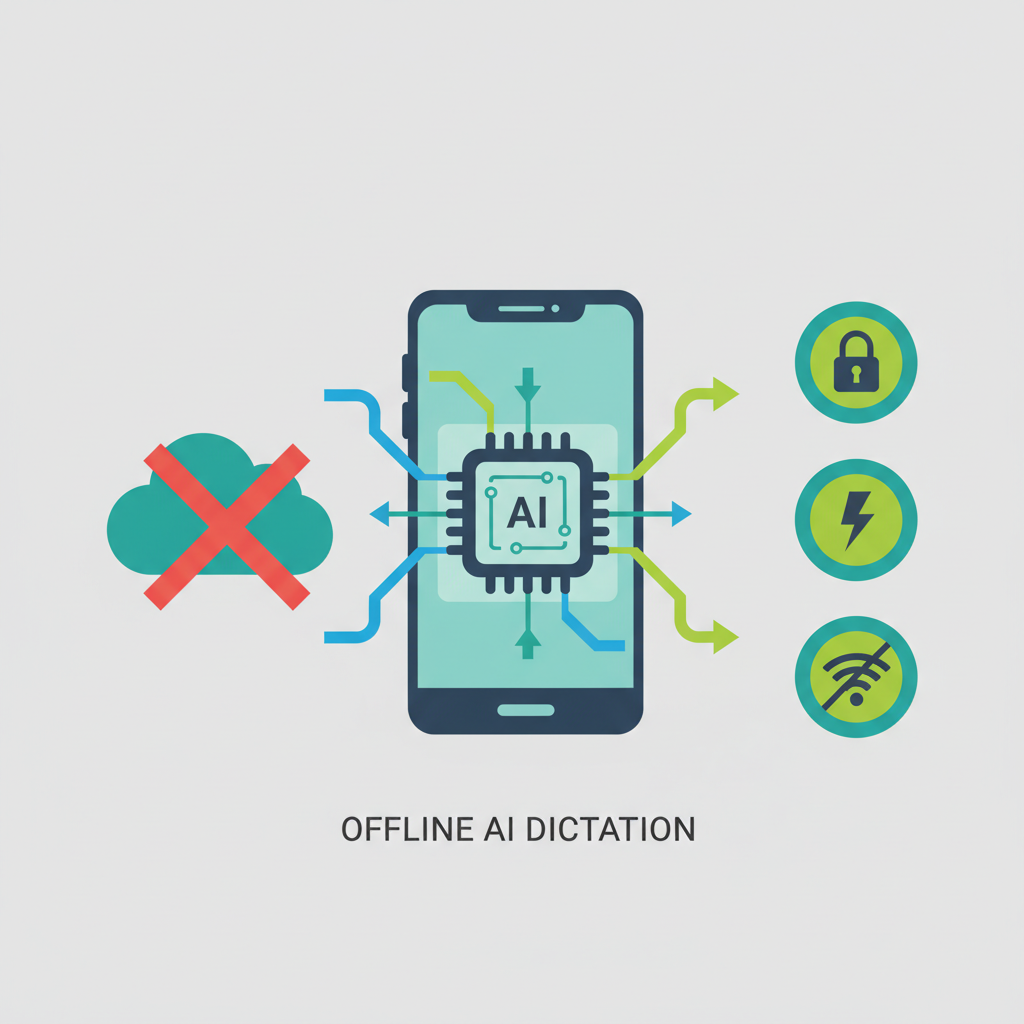

L'IA embarquée désigne des modèles d'intelligence artificielle qui s'exécutent directement sur l'appareil de l'utilisateur — smartphone, tablette, ordinateur portable — sans envoyer de données vers des serveurs distants. Contrairement aux solutions cloud classiques, tout le traitement se fait localement.

Jusqu'ici, les applications de dictée les plus performantes (comme Otter.ai, Whisper via API, ou Wispr Flow) nécessitaient une connexion internet pour envoyer l'audio vers des serveurs IA. L'on-device AI supprime cette dépendance, avec des bénéfices directs sur la confidentialité, la latence et la disponibilité.

Les avantages clés de l'approche hors ligne

- Confidentialité renforcée : Les données vocales ne quittent jamais l'appareil. Aucun enregistrement transmis à des tiers.

- Fonctionnement sans connexion : Idéal en avion, en zone blanche, ou dans des environnements réseau restreints.

- Latence quasi nulle : Le traitement local élimine les allers-retours réseau, rendant la transcription instantanée.

- Réduction des coûts d'infrastructure : Pas d'appels API facturés à l'usage pour les développeurs intégrant la solution.

- Conformité réglementaire facilitée : Moins de flux de données à encadrer au regard du RGPD ou d'autres réglementations sectorielles.

Gemma : le modèle IA de Google taillé pour l'embarqué

Le choix de Gemma comme moteur de cette application de dictée n'est pas un hasard. Lancée par Google DeepMind, Gemma est une famille de modèles de langage légers, open-source et optimisés pour tourner sur des appareils à ressources limitées. C'est précisément ce qui la rend adaptée à un usage on-device.

| Critère | IA Cloud (ex. Whisper API) | IA embarquée (Gemma on-device) |

|---|---|---|

| Connexion internet requise | ✅ Oui | ❌ Non |

| Données envoyées à des serveurs | ✅ Oui | ❌ Non |

| Latence de traitement | Moyenne à élevée (réseau) | Très faible (local) |

| Coût par requête | Facturation à l'usage | Nul après déploiement |

| Conformité RGPD | Complexe (transferts de données) | Simplifiée (données locales) |

| Disponibilité hors ligne | ❌ Non | ✅ Oui |

| Taille du modèle | Illimitée (côté serveur) | Optimisée pour l'appareil |

Gemma existe en plusieurs tailles (1B, 3B, 7B paramètres et au-delà), permettant aux développeurs de choisir le bon équilibre entre performance et empreinte mémoire selon les appareils ciblés. Pour une application de dictée, les versions les plus légères suffisent à produire une transcription de haute qualité en temps réel.

Ce que cela signifie concrètement pour les entreprises

Pour les organisations qui cherchent à intégrer des outils de productivité vocale dans leurs workflows, l'arrivée d'une solution IA hors ligne de qualité Google représente un tournant. Voici les cas d'usage les plus impactants :

Secteurs particulièrement concernés

- Santé : Les médecins et infirmiers peuvent dicter des notes cliniques sans risque de fuite de données patients vers le cloud. La conformité HIPAA (États-Unis) ou HDS (France) devient plus simple à assurer.

- Juridique : Les avocats traitant des dossiers confidentiels peuvent transcrire des notes sans exposer des informations protégées par le secret professionnel.

- Finance et banque : Les conseillers en déplacement peuvent dicter des comptes-rendus de réunion sans enfreindre les politiques de sécurité des données financières.

- Défense et gouvernement : Les environnements à accès restreint ou classifiés peuvent enfin bénéficier d'outils IA modernes sans compromis sur la sécurité.

- Journalisme de terrain : Les reporters en zones de conflit ou sans réseau peuvent transcrire leurs interviews immédiatement.

Les DSI et responsables conformité peuvent désormais envisager des déploiements d'outils IA vocaux sans passer par des processus d'homologation cloud longs et coûteux. L'on-device AI réduit drastiquement la surface d'attaque et simplifie les analyses d'impact sur la protection des données (AIPD/DPIA).

Questions à se poser avant d'adopter

- Quels appareils sont utilisés par vos équipes ? (compatibilité iOS/Android/desktop)

- Quelle est la sensibilité des données vocales traitées ?

- Avez-vous besoin d'une intégration avec vos outils existants (CRM, EHR, suite bureautique) ?

- Quelle précision de transcription est requise pour vos langues et accents métier ?

- Votre politique IT autorise-t-elle l'installation d'applications Google sur les appareils professionnels ?

Pour les développeurs : Gemma comme brique fondamentale de l'IA privée

Au-delà de l'application grand public, le vrai signal envoyé par Google s'adresse aux développeurs et éditeurs de logiciels. En montrant qu'un cas d'usage aussi exigeant que la dictée en temps réel peut tourner entièrement on-device avec Gemma, Google valide une approche architecturale que beaucoup hésitaient encore à adopter.

Ce que les développeurs peuvent construire avec Gemma on-device

- Applications de prise de notes intelligentes avec résumé automatique hors ligne

- Assistants vocaux d'entreprise sans dépendance à des APIs tierces

- Outils de transcription de réunions respectueux du RGPD

- Interfaces conversationnelles pour des appareils IoT ou edge computing

- Fonctionnalités d'accessibilité (sous-titrage temps réel, aide à la rédaction) intégrées nativement

L'on-device AI impose des contraintes réelles : taille du modèle à télécharger (plusieurs centaines de Mo à quelques Go), consommation batterie accrue lors des inférences intensives, et performances variables selon les générations d'appareils. Une stratégie de fallback cloud peut rester pertinente pour les appareils anciens ou les tâches complexes.

Écosystème et outils disponibles

Google met à disposition plusieurs outils pour intégrer Gemma dans des applications mobiles et desktop :

- MediaPipe LLM Inference API : Pour exécuter des modèles Gemma directement sur Android et iOS

- Google AI Edge : Suite d'outils pour optimiser et déployer des modèles IA sur appareils

- Hugging Face : Les modèles Gemma sont disponibles en open-source pour fine-tuning et déploiement personnalisé

- TensorFlow Lite / LiteRT : Pour des déploiements optimisés sur mobile

Face à Wispr Flow et aux autres : Google peut-il s'imposer ?

L'application de dictée de Google entre en concurrence directe avec des acteurs déjà bien établis dans la productivité vocale. Voici comment se positionne la nouvelle venue :

| Application | Modèle IA | Hors ligne | Open-source | Plateforme | Prix |

|---|---|---|---|---|---|

| Google (Gemma) | Gemma (Google) | ✅ Oui | ✅ Oui | iOS (et +) | À confirmer |

| Wispr Flow | Whisper + LLM cloud | ❌ Non | ❌ Non | macOS, Windows | Freemium |

| Otter.ai | Propriétaire cloud | ❌ Non | ❌ Non | iOS, Android, Web | Freemium |

| Apple Dictation | Apple on-device | ✅ Oui | ❌ Non | iOS, macOS | Gratuit (natif) |

| Whisper (OpenAI) | Whisper | ⚠️ Via self-hosting | ✅ Oui | Multi (API) | API payante |

L'avantage concurrentiel de Google repose sur trois piliers : la marque et la confiance des utilisateurs, la qualité reconnue de Gemma dans les benchmarks de modèles légers, et l'intégration potentielle avec l'écosystème Google Workspace. Si Google choisit d'ouvrir les APIs de cette application aux développeurs, cela pourrait rapidement devenir la référence du secteur.

La tendance de fond : vers une IA souveraine et décentralisée

Le lancement de cette application s'inscrit dans une tendance plus large que les analystes appellent l'« IA souveraine » ou l'« IA de proximité » : un mouvement qui vise à rapprocher les capacités d'intelligence artificielle des utilisateurs finaux, en réduisant la dépendance aux infrastructures centralisées.

« L'on-device AI n'est pas seulement une question de performance ou de confidentialité. C'est une question de souveraineté numérique : qui contrôle les données, qui contrôle le modèle, et qui contrôle l'expérience utilisateur. »

Les signaux qui confirment cette tendance

- Apple intègre des modèles IA directement dans ses puces (Neural Engine) depuis plusieurs générations

- Qualcomm et MediaTek optimisent leurs SoCs mobiles pour l'inférence IA locale

- Microsoft déploie Phi-3 et d'autres petits modèles pour des usages on-device dans Windows

- Meta propose Llama en open-source, facilitant les déploiements locaux

- Le marché des NPU (Neural Processing Units) dans les smartphones explose

D'ici deux ans, il est probable que la majorité des applications de productivité intègreront une couche IA on-device comme option par défaut, avec le cloud comme fallback optionnel. Les entreprises qui construisent dès aujourd'hui leurs workflows autour de cette architecture seront mieux positionnées pour répondre aux exigences réglementaires croissantes et aux attentes des utilisateurs en matière de confidentialité.

Conclusion : un signal fort pour l'avenir de la productivité IA

Le lancement discret mais stratégique de cette application de dictée hors ligne par Google avec Gemma envoie un message clair à tout l'écosystème : l'IA embarquée est mature, viable et prête pour des usages professionnels exigeants.

Pour les entreprises, c'est une invitation à repenser leurs politiques d'adoption des outils IA en intégrant la dimension on-device dès la conception. Pour les développeurs, c'est une validation technique et commerciale d'une approche architecturale qui allie performance, confidentialité et accessibilité.

Et pour les utilisateurs finaux, c'est simplement la promesse d'outils plus rapides, plus privés, et disponibles partout — même là où le réseau ne passe pas.

Points clés à retenir

- Google a lancé une application de dictée IA fonctionnant hors ligne grâce aux modèles Gemma

- L'on-device AI offre des avantages majeurs en termes de confidentialité, latence et coûts

- Les secteurs réglementés (santé, juridique, finance) sont les premiers bénéficiaires potentiels

- Gemma est disponible en open-source, permettant aux développeurs de construire leurs propres solutions

- Cette tendance s'inscrit dans un mouvement global vers une IA décentralisée et souveraine

Source : TechCrunch — Google quietly releases an offline-first AI dictation app on iOS

Besoin d'accompagnement en IA ?

Nos experts vous aident à identifier et déployer les solutions d'intelligence artificielle adaptées à votre entreprise.

Consultation stratégique offerte