L'adoption de l'IA augmente, mais la confiance des Américains diminue : quelles leçons pour les entreprises ?

Un paradoxe au cœur de la révolution IA

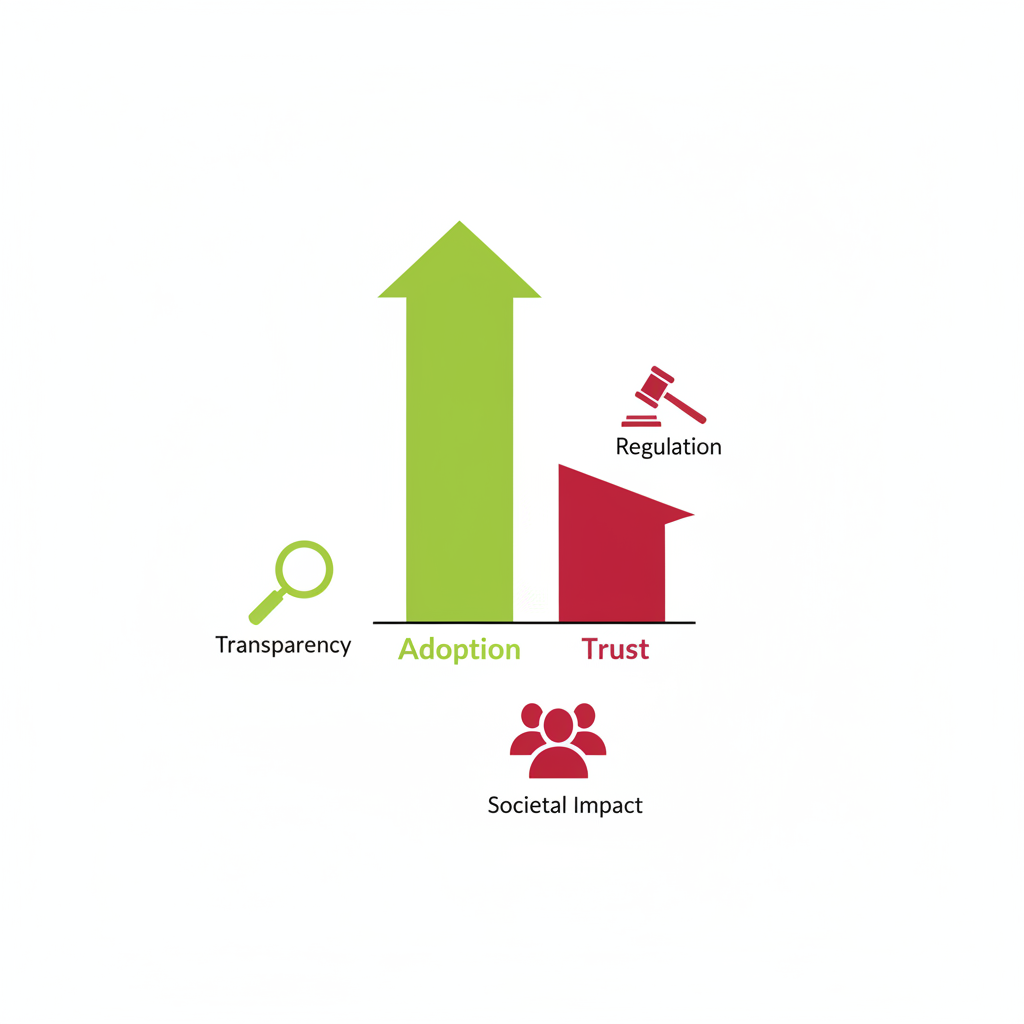

L'intelligence artificielle s'installe progressivement dans le quotidien des Américains. Pourtant, selon un récent sondage de l'Université Quinnipiac, cette adoption croissante ne s'accompagne pas d'une confiance accrue envers la technologie. Au contraire : plus les outils IA se répandent, plus la méfiance des utilisateurs s'intensifie.

« L'adoption de l'IA est en hausse aux États-Unis, mais la confiance reste faible, la majorité des Américains exprimant des inquiétudes concernant la transparence, la réglementation et l'impact sociétal plus large de la technologie. »

Ce paradoxe n'est pas anodin. Il envoie un signal fort aux entreprises qui misent sur l'IA pour transformer leurs opérations : déployer un outil ne suffit pas. Encore faut-il gagner la confiance de ceux qui l'utilisent.

Ce que disent les chiffres : adoption vs. confiance

Le sondage Quinnipiac dresse un portrait nuancé de la relation des Américains avec l'IA. Les données révèlent une fracture profonde entre l'usage et la confiance accordée aux résultats produits.

| Indicateur | Résultat | Interprétation |

|---|---|---|

| Adoption des outils IA | En hausse significative | L'IA s'intègre dans les usages quotidiens et professionnels |

| Confiance dans les résultats IA | En baisse | Les utilisateurs doutent de la fiabilité des outputs générés |

| Préoccupations sur la transparence | Majoritaires | Les Américains veulent comprendre comment fonctionne l'IA |

| Demande de réglementation | Forte | Un encadrement légal est jugé nécessaire par la majorité |

| Inquiétudes sur l'impact sociétal | Largement partagées | Emploi, biais, vie privée : les craintes sont multiples |

| Acceptation d'un superviseur IA au travail | 15% seulement | Une très large majorité refuse l'autorité managériale de l'IA |

Le chiffre le plus frappant reste peut-être celui-ci : seulement 15 % des Américains se disent prêts à accepter un poste où leur superviseur direct serait un programme d'IA chargé d'attribuer les tâches et de fixer les horaires, selon le même sondage Quinnipiac relayé par TechCrunch.

Comprendre le paradoxe : pourquoi utilise-t-on ce en quoi on n'a pas confiance ?

Ce phénomène peut sembler contre-intuitif. Comment expliquer qu'une technologie jugée peu fiable soit néanmoins adoptée massivement ? Plusieurs facteurs permettent d'éclairer cette tension :

- La pression de la productivité : Dans un contexte professionnel compétitif, les individus adoptent l'IA par nécessité ou par injonction managériale, indépendamment de leur niveau de confiance personnel.

- L'effet de commodité : Les outils IA offrent des gains de temps immédiats et tangibles, ce qui favorise leur usage même lorsque les résultats sont perçus comme imparfaits.

- Le manque d'alternatives : Dans certains secteurs, l'IA devient incontournable, laissant peu de choix aux utilisateurs.

- La dissonance cognitive : Les utilisateurs peuvent simultanément reconnaître les limites d'un outil et continuer à l'utiliser, en ajustant leurs attentes à la baisse.

- L'asymétrie d'information : Beaucoup d'utilisateurs ne comprennent pas précisément comment fonctionne l'IA, ce qui nourrit à la fois l'usage (fascination) et la méfiance (opacité).

L'IA comme manager : un rejet massif qui en dit long

La question du superviseur IA est particulièrement révélatrice des limites de l'acceptabilité sociale de l'intelligence artificielle. Avec seulement 15 % d'Américains favorables à l'idée d'être managés par un programme IA, le message est clair : la technologie est tolérée comme outil, mais pas acceptée comme autorité.

« Selon un sondage de l'Université Quinnipiac, 15 % des Américains déclarent qu'ils seraient prêts à occuper un emploi où leur superviseur direct serait un programme d'IA chargé d'attribuer des tâches et de fixer des horaires. »

Ce rejet s'explique par plusieurs dimensions fondamentales de la relation au travail :

- Le besoin de reconnaissance humaine : Les employés attendent de leur manager qu'il comprenne leur contexte, leurs émotions et leurs contraintes personnelles — des capacités que l'IA ne possède pas encore de manière satisfaisante.

- La question de la responsabilité : Qui est responsable quand un algorithme prend une mauvaise décision managériale ? L'absence de responsabilité claire génère de l'anxiété.

- La peur de la surveillance algorithmique : Un superviseur IA implique une mesure constante et automatisée de la performance, perçue comme intrusive et déshumanisante.

- Le manque de légitimité perçue : L'autorité managériale repose historiquement sur l'expérience, le jugement et la relation interpersonnelle — autant d'éléments que l'IA peine à incarner.

Les leçons concrètes pour les entreprises

Face à ce paradoxe adoption/méfiance, les entreprises qui déploient ou envisagent de déployer des solutions IA doivent adapter leur approche. Voici les enseignements stratégiques à retenir :

1. Faire de la transparence un pilier non négociable

Les préoccupations des Américains concernant la transparence sont majoritaires. Les entreprises doivent expliquer clairement comment leurs outils IA fonctionnent, quelles données ils utilisent, et comment les décisions sont prises. La boîte noire algorithmique est l'ennemi de la confiance.

- Documenter les modèles utilisés et leurs limites connues

- Communiquer sur les biais potentiels et les mesures correctives

- Rendre les processus de décision IA explicables aux utilisateurs finaux

2. Positionner l'IA comme assistant, jamais comme autorité

Le rejet massif du superviseur IA enseigne une leçon fondamentale : l'IA doit augmenter l'humain, non le remplacer dans les rôles d'autorité. Les entreprises qui présentent l'IA comme un outil d'aide à la décision rencontreront bien moins de résistance que celles qui tentent de lui déléguer des responsabilités managériales.

3. Anticiper la demande réglementaire

La forte demande de réglementation exprimée dans le sondage Quinnipiac indique que les utilisateurs souhaitent un cadre légal protecteur. Les entreprises proactives ont tout intérêt à anticiper ces évolutions réglementaires plutôt que de les subir, en adoptant dès maintenant des pratiques conformes aux standards émergents (RGPD, AI Act européen, futures législations américaines).

4. Investir dans la formation et l'accompagnement au changement

La méfiance naît souvent de l'incompréhension. Former les collaborateurs à comprendre ce que fait l'IA — et surtout ce qu'elle ne fait pas — est un investissement indispensable pour transformer la tolérance en adhésion.

5. Mesurer la confiance, pas seulement l'adoption

Les entreprises mesurent généralement le taux d'adoption de leurs outils IA. Peu mesurent le niveau de confiance de leurs utilisateurs. Or, comme le montre ce sondage, les deux métriques peuvent évoluer en sens inverse. Intégrer des indicateurs de confiance dans les tableaux de bord de déploiement IA est désormais indispensable.

Synthèse : le tableau de bord de la confiance IA en entreprise

| Dimension | Question clé à se poser | Action recommandée | Niveau de priorité |

|---|---|---|---|

| Transparence | Nos utilisateurs comprennent-ils comment l'IA prend ses décisions ? | Mettre en place des mécanismes d'explicabilité (XAI) | 🔴 Critique |

| Positionnement | L'IA est-elle présentée comme outil ou comme autorité ? | Recentrer la communication sur l'augmentation humaine | 🔴 Critique |

| Conformité | Anticipons-nous les évolutions réglementaires ? | Audits réguliers et veille réglementaire active | 🟠 Haute |

| Formation | Nos collaborateurs sont-ils formés aux limites de l'IA ? | Programmes de littératie IA pour tous les niveaux | 🟠 Haute |

| Mesure | Mesurons-nous la confiance en plus de l'adoption ? | Intégrer des KPIs de confiance dans les dashboards | 🟡 Importante |

| Impact sociétal | Évaluons-nous les effets de l'IA sur nos parties prenantes ? | Conduire des études d'impact régulières | 🟡 Importante |

Conclusion : la confiance, nouveau KPI stratégique de l'IA

Le sondage Quinnipiac met en lumière une vérité inconfortable pour l'industrie technologique : l'adoption massive d'un outil ne signifie pas son acceptation. Les entreprises qui confondent les deux risquent de construire sur des fondations fragiles.

Dans un contexte où les préoccupations autour de la transparence, de la réglementation et de l'impact sociétal de l'IA sont majoritaires parmi les Américains, le déploiement responsable de l'intelligence artificielle n'est plus une option éthique facultative — c'est un impératif stratégique.

Le paradoxe adoption/méfiance n'est pas une fatalité. Il est une invitation à faire mieux, à communiquer davantage, et à concevoir des systèmes IA qui méritent véritablement la confiance qu'on leur demande d'inspirer.

Sources : TechCrunch – AI Trust & Adoption Poll | TechCrunch – AI Work Supervisor Poll — Sondage Quinnipiac University, mars 2026.

Besoin d'accompagnement en IA ?

Nos experts vous aident à identifier et déployer les solutions d'intelligence artificielle adaptées à votre entreprise.

Consultation stratégique offerte