Gemma 4 : Google DeepMind lance ses modèles open source les plus puissants par paramètre

Gemma 4 : une nouvelle ère pour l'IA open source

Le 2 avril 2026, Google DeepMind a officiellement lancé Gemma 4, sa quatrième génération de modèles de langage open source. Cette famille regroupe quatre modèles de vision-langage (VLMs) dotés de capacités de raisonnement avancées, tous publiés sous la licence Apache 2.0, l'une des plus permissives de l'écosystème open source.

« Google met en avant un niveau d'intelligence par paramètre sans précédent, fournissant encore plus de preuves que la création de petits modèles utiles est l'un des domaines de recherche les plus actifs en ce moment. »

Ce lancement s'inscrit dans une tendance de fond : la course à l'efficacité paramétrique, c'est-à-dire la capacité à obtenir des performances maximales avec un nombre minimal de paramètres. Pour les développeurs et les entreprises, cela représente une opportunité majeure de déployer des LLMs puissants sans infrastructure colossale.

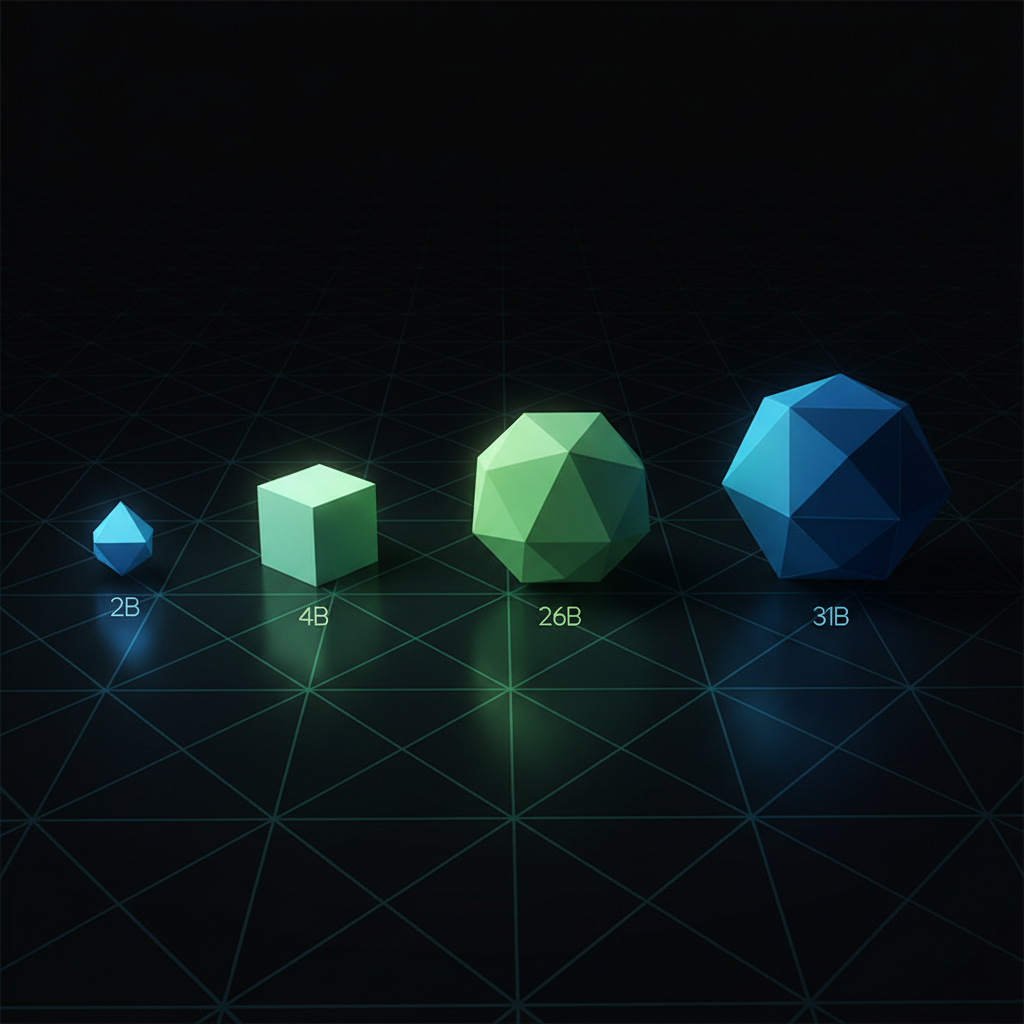

Les quatre modèles Gemma 4 en détail

La famille Gemma 4 se décline en quatre variantes, chacune ciblant des cas d'usage et des contraintes matérielles différents :

| Modèle | Taille | Architecture | Vision | Licence | Cas d'usage idéal |

|---|---|---|---|---|---|

| Gemma 4 2B | 2 milliards de paramètres | Dense | ✅ Oui | Apache 2.0 | Edge computing, appareils mobiles, prototypage rapide |

| Gemma 4 4B | 4 milliards de paramètres | Dense | ✅ Oui | Apache 2.0 | Applications embarquées, chatbots légers |

| Gemma 4 26B-A4B | 26B total / 4B actifs | Mixture-of-Experts (MoE) | ✅ Oui | Apache 2.0 | Performances élevées à coût computationnel réduit |

| Gemma 4 31B | 31 milliards de paramètres | Dense | ✅ Oui | Apache 2.0 | Raisonnement complexe, tâches enterprise avancées |

Le modèle 26B-A4B mérite une attention particulière : il s'agit d'un modèle Mixture-of-Experts (MoE) qui, malgré ses 26 milliards de paramètres totaux, n'en active que 4 milliards lors de chaque inférence. Cette architecture permet d'obtenir des performances proches d'un modèle dense de grande taille, tout en conservant une empreinte computationnelle comparable à un modèle 4B.

L'intelligence par paramètre : le nouveau champ de bataille de l'IA

La notion d'intelligence par paramètre est au cœur de la stratégie de Google DeepMind avec Gemma 4. Plutôt que de simplement empiler des milliards de paramètres supplémentaires, l'objectif est d'extraire le maximum de valeur de chaque paramètre existant.

Un modèle plus petit mais plus efficace peut être déployé sur du matériel standard, réduisant drastiquement les coûts d'infrastructure et ouvrant l'accès à l'IA avancée à un plus grand nombre d'acteurs.

Cette tendance n'est pas propre à Google. Elle reflète une évolution profonde de la recherche en IA :

- Distillation des connaissances : les grands modèles servent de « professeurs » pour entraîner des modèles plus petits mais très performants.

- Architectures MoE : l'activation sélective des paramètres permet de découpler la taille totale du modèle de son coût d'inférence.

- Optimisation des données d'entraînement : la qualité des données prime désormais sur leur quantité brute.

- Quantification avancée : des techniques comme GGUF ou AWQ permettent de réduire l'empreinte mémoire sans perte significative de performance.

Gemma 4 s'inscrit pleinement dans cette dynamique, avec des modèles qui visent à surpasser des concurrents bien plus grands en termes de benchmarks de raisonnement et de compréhension multimodale.

Impact sur l'écosystème IA open source

Le lancement de Gemma 4 envoie un signal fort à l'ensemble de l'écosystème IA open source. Voici les principales implications :

Pour les développeurs individuels

- Accès à des modèles de niveau professionnel exécutables sur un GPU grand public (RTX 3090, RTX 4080, etc.)

- Capacités multimodales natives (texte + image) sans surcoût

- Intégration facilitée via des outils comme Ollama, LM Studio ou llama.cpp

- Liberté totale d'utilisation commerciale grâce à la licence Apache 2.0

Pour les entreprises et startups

- Réduction des coûts : déploiement on-premise sans dépendance aux APIs propriétaires facturées à l'usage

- Souveraineté des données : les données sensibles ne quittent pas l'infrastructure interne

- Personnalisation : fine-tuning possible sur des données métier spécifiques

- Conformité réglementaire : plus facile à auditer qu'un modèle en boîte noire

Pour la recherche académique

- Modèles de référence accessibles pour reproduire et comparer des expériences

- Base solide pour explorer de nouvelles architectures ou techniques d'entraînement

Malgré la licence Apache 2.0, Google impose des conditions d'utilisation spécifiques pour Gemma (les « Gemma Terms of Use »). Il est essentiel de les lire attentivement avant tout déploiement commercial à grande échelle.

Gemma 4 dans l'écosystème Gemini : une intégration cohérente

Le lancement de Gemma 4 ne se fait pas en isolation. Il s'accompagne de mises à jour dans l'écosystème Gemini de Google, avec notamment l'ajout de nouveaux modèles accessibles via API :

« Nouveaux modèles :

gemini-3.1-flash-lite-preview,gemma-4-26b-a4b-itetgemma-4-31b-it. »

Cette double stratégie — modèles open source téléchargeables et accès API — illustre l'approche hybride de Google : permettre à la communauté d'expérimenter librement tout en maintenant une offre cloud compétitive face à OpenAI et Anthropic.

Les identifiants de modèles gemma-4-26b-a4b-it et gemma-4-31b-it (suffixe -it pour instruction-tuned) indiquent que ces versions sont optimisées pour suivre des instructions, ce qui les rend immédiatement utilisables dans des applications conversationnelles sans fine-tuning supplémentaire.

Gemma 4 face à la concurrence open source

Pour contextualiser la portée de Gemma 4, il est utile de le situer par rapport aux autres acteurs majeurs de l'IA open source :

| Famille | Éditeur | Tailles disponibles | Vision native | Licence | MoE disponible |

|---|---|---|---|---|---|

| Gemma 4 | Google DeepMind | 2B, 4B, 26B-MoE, 31B | ✅ Oui | Apache 2.0* | ✅ Oui |

| Llama 3.x | Meta | 1B, 3B, 8B, 70B, 405B | ✅ Oui (vision) | Llama Community | ❌ Non |

| Mistral / Mixtral | Mistral AI | 7B, 8x7B, 8x22B | ⚠️ Partiel | Apache 2.0 | ✅ Oui |

| Qwen 2.5 | Alibaba | 0.5B à 72B | ✅ Oui | Apache 2.0 / Qwen | ✅ Oui |

| Phi-4 | Microsoft | 3.8B, 14B | ✅ Oui | MIT | ❌ Non |

* Sous réserve des Gemma Terms of Use additionnels.

Gemma 4 se distingue notamment par la combinaison unique de vision native sur tous les modèles, d'une architecture MoE disponible dès la gamme intermédiaire, et d'une licence parmi les plus permissives du marché.

Comment déployer Gemma 4 : guide pratique pour les développeurs

Voici les principales voies d'accès et de déploiement pour Gemma 4 :

-

Via Hugging Face Hub

Les modèles Gemma 4 sont disponibles sur Hugging Face. Après acceptation des conditions d'utilisation, ils peuvent être téléchargés et utilisés avec la bibliothèque

transformersde Hugging Face. -

Via Ollama (usage local)

Ollama supporte nativement les modèles Gemma. Une simple commande

ollama pull gemma4:27b(nom indicatif) suffit pour télécharger et exécuter le modèle localement. -

Via Google AI Studio / Vertex AI

Pour les équipes qui préfèrent une infrastructure managée, Google propose les variantes instruction-tuned (

gemma-4-31b-it,gemma-4-26b-a4b-it) directement via ses APIs cloud. -

Via llama.cpp / GGUF

Des versions quantifiées au format GGUF permettront d'exécuter Gemma 4 sur CPU ou GPU grand public, avec une empreinte mémoire réduite.

Pour une première expérimentation, le modèle Gemma 4 4B offre le meilleur équilibre entre performance et accessibilité matérielle. Il peut tourner confortablement sur un GPU avec 8 Go de VRAM en précision FP16, ou sur 6 Go avec quantification 4-bit.

Conclusion : Gemma 4, un tournant pour l'IA open source accessible

Gemma 4 représente bien plus qu'une simple mise à jour technique. C'est un signal stratégique fort de Google DeepMind : l'avenir de l'IA n'appartient pas uniquement aux modèles massifs accessibles uniquement via API payante. Les petits modèles efficaces, déployables localement, constituent une alternative crédible et de plus en plus compétitive.

Pour les développeurs et entreprises, les implications sont concrètes :

- ✅ Indépendance vis-à-vis des fournisseurs cloud propriétaires

- ✅ Contrôle total sur les données et les coûts d'inférence

- ✅ Flexibilité pour personnaliser et fine-tuner selon les besoins métier

- ✅ Capacités multimodales sans surcoût supplémentaire

La compétition entre Google, Meta, Mistral, Alibaba et Microsoft dans l'espace open source ne fait que s'intensifier, et c'est l'ensemble de l'écosystème — et in fine les utilisateurs finaux — qui en bénéficie. Gemma 4 place la barre très haut pour 2026.

Pour suivre les dernières analyses sur ces modèles, les notes détaillées de Simon Willison constituent une ressource de référence : analyse de Gemma 4 et intégration dans l'écosystème Gemini.

Besoin d'accompagnement en IA ?

Nos experts vous aident à identifier et déployer les solutions d'intelligence artificielle adaptées à votre entreprise.

Consultation stratégique offerte